更強感知和定位能力!極智嘉聯合卡耐基梅隆大學提出全新提取對象描述符算法

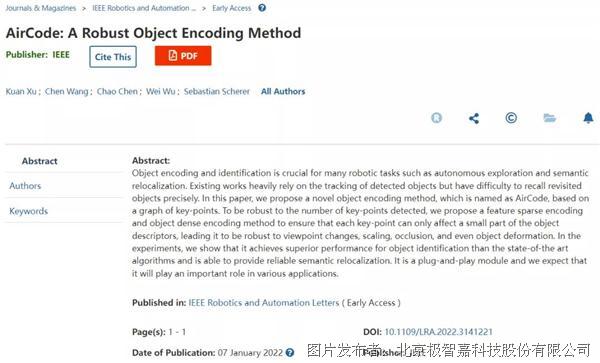

近日,全球AMR引領者極智嘉(Geek+)聯合卡耐基梅隆大學(CMU)提出了的全新提取對象描述符算法,并成功在著名機器人期刊IEEE Robotics and Automation Letters(RA-L)上發表,充分印證了極智嘉在移動機器人視覺感知和V-SLAM定位導航方面的創新能力與技術實力備受學術權威的認可!

IEEE Robotics and Automation Letters (RA-L)是機器人領域的知名短文頂刊,屬JCR一區期刊,在Google h5-index上機器人領域綜合排名第二,期刊排名第一,享有較高知名度和權威性。

全新提取對象描述符算法

大幅提升感知和定位能力

對象描述和匹配對機器人的視覺感知及V-SLAM定位有著重要作用。尤其是在語義SLAM方面,對象匹配既有助于前后幀相對位姿的計算,也可以輔助更加準確的檢測回環,從而建立高精度的地圖。為此,極智嘉提出全新的提取對象描述符算法,同時利用卷積神經網絡(CNN)和圖神經網絡(GNN)來編碼對象攜帶的信息,可用于對象的匹配和視覺重定位,大幅提升視覺地圖的精度和重定位的準確率,強化機器人感知和定位能力,在完成更復雜的業務任務的同時減少錯誤概率。

極智嘉訂單到人揀選機器人A60C采用激光SLAM+視覺SLAM導航技術運行在人機混合的復雜場景中,需要非常準確的定位和對象識別能力。本文提出的全新提取對象描述符算法既提升了A60C機器人的對象感知能力,也提高了該款機器人V-SLAM定位的準確率,使其滿足幾乎所有工業、倉庫場景實時變化的需求,并且確保人機混行的安全性。

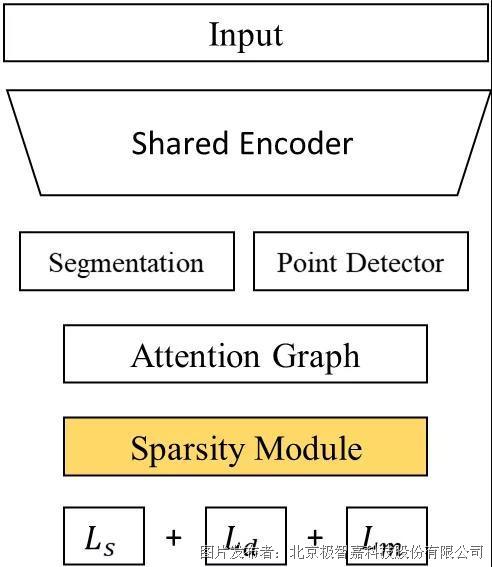

算法成果詳解

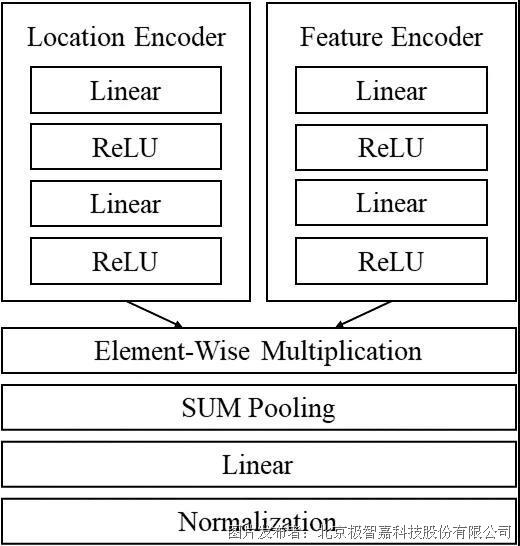

算法的流程如圖1左所示。首先,利用卷積網絡提取圖像的特征圖,并用一個語義分割的Header和一個特征點提取的Header獲取這張圖像上的對象掩膜和對象上對應的特征點。然后利用注意力機制將對象上離散的特征點形成一個加權無向圖,并用圖網絡處理這個加權無向圖。最后,用一個特征稀疏模塊將多個低維特征聚合成一個高維的對象描述符。

圖1.算法流程(左)和特征稀疏模塊流程(右)

為了解決不同視角下同一對象上特征點數量差異造成對象匹配困難的問題,極智嘉在文中提出了一種特征稀疏聚合的算法。如圖1右所示,兩個網絡分支可以同時學習特征點內容信息和特征點所占據對象描述符的位置信息,其結果按元素相乘聚合后再進行二范數歸一化。

網絡訓練的損失函數包含三部分:稀疏化損失函數——使聚合前特征點變得更稀疏以降低單個特征點對對象描述符的影響,稠密化損失函數——使最終的對象描述符更加稠密以增加描述符的空間利用率,和匹配損失函數——降低不同圖像上同一對象描述符的距離,同時增加不同對象描述符的距離。

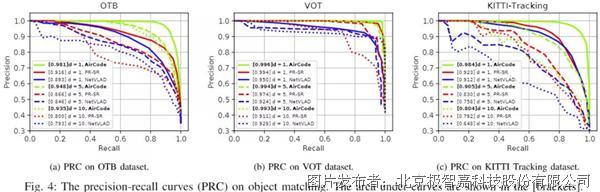

新算法在OTB,VOT和KITTI數據集上取得了優異的對象匹配和重定位效果,實驗結果表明其性能超越了著名的特征聚合算法NetVLAD以及對象匹配算法PR-SR。

圖2.對象匹配實驗結果

圖3.KITTI Odometry數據集上重定位效果

論文鏈接:https://arxiv.org/pdf/2105.00327.pdf

工程代碼:https://github.com/wang-chen/AirCode

提交

極智嘉 x 柯爾柏: 賦能美國知名鞋服品牌Ariat實現供應鏈數智化升級

極智嘉攜手盈智科技率先落地無人化港口冷鏈智慧倉

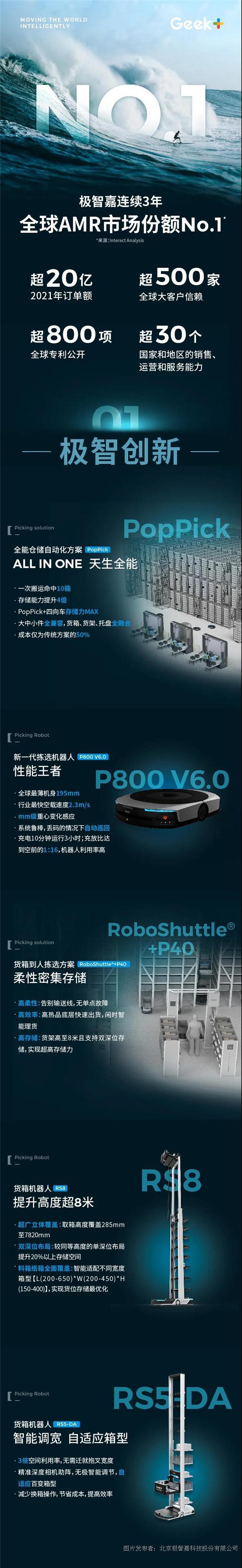

訂單額超20億!極智嘉2021年成績單出爐!

極智嘉與緯創資通達成戰略合作,領跑電子制造業全流程柔性“智”造升級

聚力攜手!極智嘉賦能國際領先物流集團Rhenus落地亞洲首個AMR智能倉

投訴建議

投訴建議